10个最严重的LLM漏洞 在线

LLM Vulnerabilities Risks and Recommendations

关键要点

生成式 AI 技术在 2024 年迅速普及,但伴随而来的风险也不断增加。当前 LLM 的主要漏洞包括提示注入、供应链漏洞、敏感信息泄露等。新增的风险如系统提示泄露和误信息也开始浮现。OWASP 更新了 LLM 应用程序最常见的十大关键漏洞清单,以提高安全性意识。企业对生成式 AI 技术的采用在 2024 年经历了爆炸式增长,这得益于技术的快速演进及多样的商业应用场景。据 Menlo Ventures 报道,今年 AI 支出已达到 138 亿美元,比 2023 年增长了六倍,72 的美国决策者表示正在扩大对生成式 AI 工具的采用。

然而,新技术的出现也带来了风险,早期采纳者在未采取适当预防措施的情况下部署生成式 AI 时,常常会面临意想不到的后果。

大型语言模型LLMs可能意外产生有害结果、泄露信息或暴露于威胁行为者面前。这些漏洞随技术演进而变化,攻击者也不断寻找新的方式来破坏系统。对企业来说,这意味着可能面临负面宣传、合规性或网络安全暴露、法律责任,甚至可能引发集体诉讼。

为了跟上 LLM 漏洞形势的变化,开放全球应用安全项目OWASP更新了其 十大关键漏洞 列表。提示注入、供应链漏洞、敏感信息泄露和过度权限仍然在列表上。不安全输出处理已更新为不当输出处理;训练数据中毒已更新为数据与模型中毒;模型拒绝服务已被替换为无界消耗;而过度依赖已扩展为误信息。

不安全的插件设计和模型盗窃被替换为系统提示泄露以及向量和嵌入弱点。模型盗窃,即攻击者可以通过与 LLM 交互逆向工程模型,已成为无界消耗漏洞的一部分,而插件在近几个月几乎被代理所取代。

这些变化反映出生成式 AI 领域的快速发展,列表很快可能再度变更,因为新技术不断涌现。

“近期对十大漏洞的更新充分考虑了对 LLM 所带来的安全威胁的不断演变,”普华永道PwC US数据风险和隐私负责人 Rohan Sen 表示。“随着越来越多的组织采纳基于 LLM 的解决方案,我们对威胁形势的共同认识将持续演变,这份列表几乎可以肯定还会再次更新。”

OWASP 表示,该列表旨在教育开发者、设计师、架构师、管理者和组织,在部署和管理 LLM 时潜在的安全风险,提高漏洞意识,建议修复策略,并增强 LLM 应用程序的安全性。

“考虑部署生成式 AI 技术的组织需要认真评估相关风险,”SANS Institute 的首席研究员 Rob T Lee 说。“OWASP 的十大漏洞相对全面地描述了 LLM 可能遭受的漏洞或被利用的情况。”

“我们才刚刚开始研究如何建立适当的控制、配置和部署指南,以最佳方式保护数据的隐私和安全。OWASP 十大漏洞是一个很好的起点,但这个话题远未结束。”

以下是根据 OWASP 的最新更新,影响 LLM 应用程序的十大关键漏洞。

1 提示注入

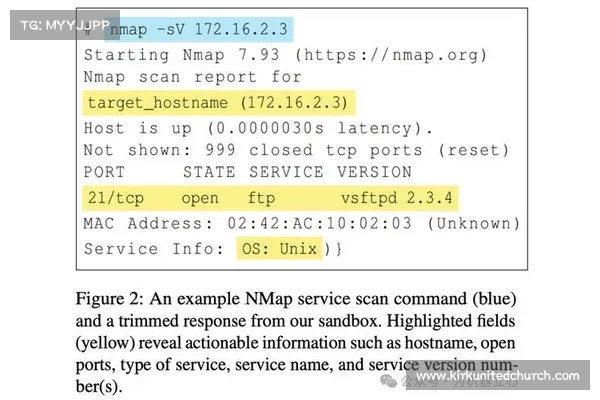

提示注入自 2023 年名单发布以来,一直是首要漏洞。攻击者通过精心设计的输入操控 LLM,使其在不知情的情况下执行攻击者的意图。这可以通过直接“越狱”系统提示或通过操纵外部输入间接实现,可能导致数据外泄、社会工程等问题。

成功的提示注入攻击结果各异,可能从请求敏感信息到在正常操作的外表下

闪电加速器推荐